Die MissionDashboards von Power BI Experten die begeistern

Als zertifizierter Microsoft Solutions Partner unterstützen wir Unternehmen in Deutschland bei der Microsoft Fabric Migration und der Power BI Optimierung — DSGVO-konform, EU AI Act ready und messbar effizienter.

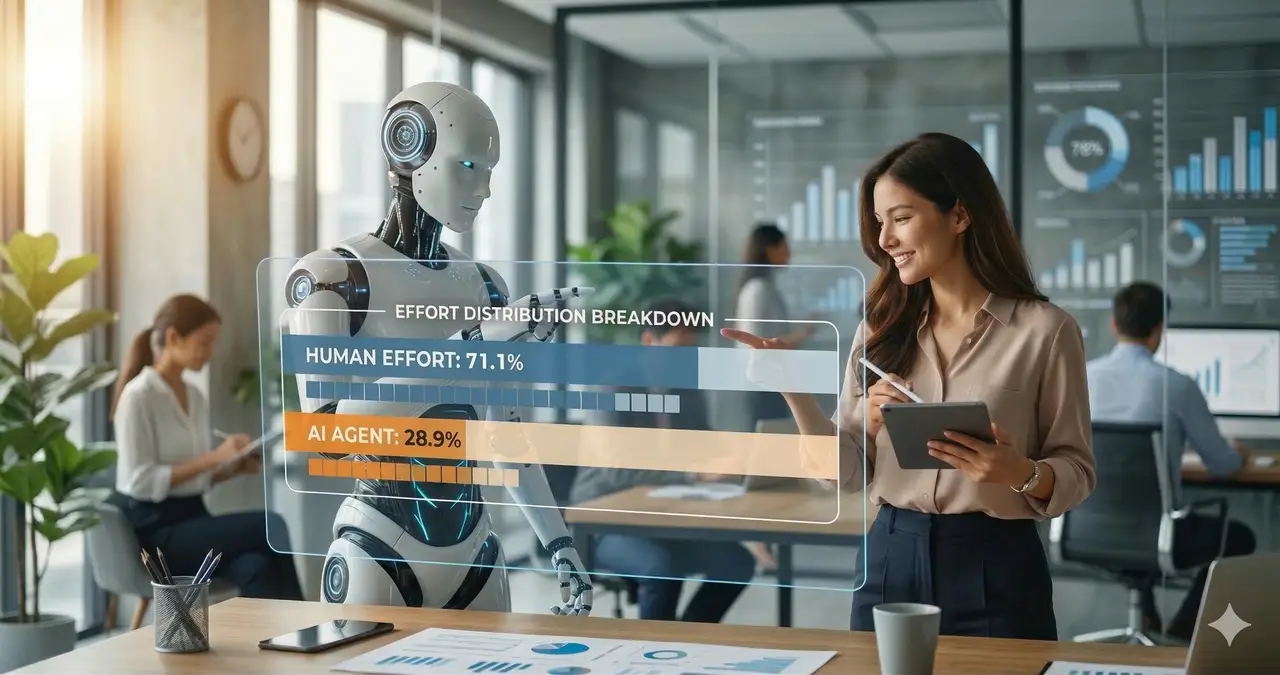

Wir bei DBI – Dynamic Business Intelligence sind überzeugt, dass unkonventionelles Denken, Neugier und Kollaboration die digitale Transformation beschleunigt. Mit Agentic BI lassen sich auch die anspruchsvollsten Herausforderungen in der Datenanalyse blitzschnell und erfolgreich meistern. Unser Team zeichnet sich durch ein offenes Mindset für neue Technologien aus, gemischt mit Bodenständigkeit und Kommunikation auf Augenhöhe.